Krieg im Nahen Osten: Kampf um die Wahrheit und Deutung

Seit dem Beginn des Krieges im Nahen Osten werden online massenhaft Falschinformationen und KI-Fakes verbreitet. Wer dahinter steckt und was das Informationsumfeld in diesem Fall besonders kompliziert macht.

Der Krieg im Nahen Osten wird von Desinformationskampagnen und einer Flut von KI-generierten und aus dem Kontext gerissenen Videos und Bildern in sozialen Medien begleitet. Der bewaffnete Konflikt wird auch im Cyber- und Informationsraum ausgefochten – mit Cyberangriffen und Einflusskampagnen. Diese Dimension der modernen Kriegsführung ist nicht mehr wegzudenken. Damit versuchen die Kriegsparteien, das Umfeld jeweils zu ihren Gunsten zu beeinflussen, die Moral der eigenen Seite zu stärken, die Gegner zu schwächen und die Deutungshoheit über den Konflikt zu gewinnen. Auch wenn Informationskriegsführung an sich kein neues Phänomen ist, werden manipulierte digitale Inhalte über den aktuellen Krieg im Nahen Osten dank der generativen KI im besonders großen Ausmaß produziert und Hunderte Millionen Male an Nutzer:innen weltweit ausgespielt. Die schwersten Konsequenzen sind unter anderem Normalisierung und Glorifizierung der Gewalt, Dehumanisierung der Gegner:innen sowie Zweifel an echten Bildern der humanitären Folgen des Krieges.

Das komplizierte Informationsumfeld

Mehrere Faktoren machen das Informationsumfeld rund um den Krieg im Nahen Osten besonders anfällig für die Verbreitung von Des- und Misinformation. Der Internet-Shutdown, den das iranische Regime am 28. Februar 2026, nach dem Beginn des Krieges, verhängte, um die eigene Bevölkerung zu kontrollieren, führt zu einem Informationsvakuum. Im Vergleich zu anderen Kriegsgebieten gelangen deutlich weniger Augenzeugenvideos und -bilder aus dem Iran nach außen, was die Arbeit der Faktenchecker:innen und OSINT-Researcher:innen erschwert. Auch die Arbeit mit Sattelitenbildern ist beeinträchtigt, nachdem zwei US-Unternehmen Einschränkungen und Verzögerungen bei der Veröffentlichung von Sattelitenbildern aus der Region einführten, um zu verhindern, dass diese für Angriffe auf NATO-Personal und ihre Verbündeten genutzt werden. In den Vereinigten Arabischen Emiraten und Katar wurden Menschen festgenommen, weil sie Aufnahmen von iranischen Angriffen veröffentlichten.

In einer Situation, in der die Möglichkeiten professioneller Medien, Informationen zu bekommen und zu verifizieren, stark eingeschränkt sind, wird das daraus resultierende Informationsvakuum mit Desinformation, Propaganda und widersprüchlichen Deutungen gefüllt. Wie die Researcherinnen Shirin Anlen und Mahsa Alimardani schreiben, setze der iranische Staat die Infrastruktur der Staatsmedien ein, um zivile Opfer der US-amerikanischen und israelischen Angriffe im Iran zu dokumentieren – doch während das Regime Tausende Protestierende im Januar 2026 umbrachte, habe es keine solche Infrastruktur gegeben. Echte Bilder der Zerstörungen würden von iranischen Medien für Propaganda instrumentalisiert und gleichzeitig werdeihre Echtheit online angezweifelt. Das Massaker an den Protestierenden habe den Informationskampf zwischen dem Regime, der Opposition, den Diaspora-Gruppen und den ausländischen Staaten verschärft – alle diese Akteure versuchten jetzt, die öffentliche Wahrnehmung des Konflikts zu beeinflussen.

Die involvierten Staaten sind erfahren im Bereich der Informationsmanipulation und Informationskontrolle. Der Iran setzt seit Jahrzehnten Zensur und Propaganda im Inland sowie offene und verdeckte Einflusskampagnen im Ausland ein, die gut dokumentiert sind. Recherchen von Citizen Lab, Haaretz und The New York Times deckten in der letzten Zeit mehrere mutmaßliche israelische verdeckte Online-Einflusskampagnen auf. Diese verfolgten das Ziel, das iranische Regime zu stürzen oder die öffentliche Meinung in den USA über den Krieg in Gaza zu beeinflussen.

Erschwert wird die bereits unübersichtliche Situation dadurch, dass generative KI inzwischen so weit fortgeschritten ist, dass damit massenhaft fotorealistische Bilder und Videos erzeugt werden können, deren Unechtheit häufig nur schwer zu identifizieren und nachzuweisen ist. Auch professionelle Medien veröffentlichten Agenturbilder über den aktuellen Krieg, die, wie sich später herausstellte, mit hoher Wahrscheinlichkeit KI-generiert oder -manipuliert wurden. KI-generierte Inhalte über Konflikte werden in sozialen Medien nicht nur von politischen, sondern auch von kommerziellen Akteur:innen verbreitet, die sich erhoffen, mit Sensationsbildern und -videos Reichweiten zu generieren und die Inhalte zu monetarisieren.

Pro-iranische Desinformation dominiert soziale Medien

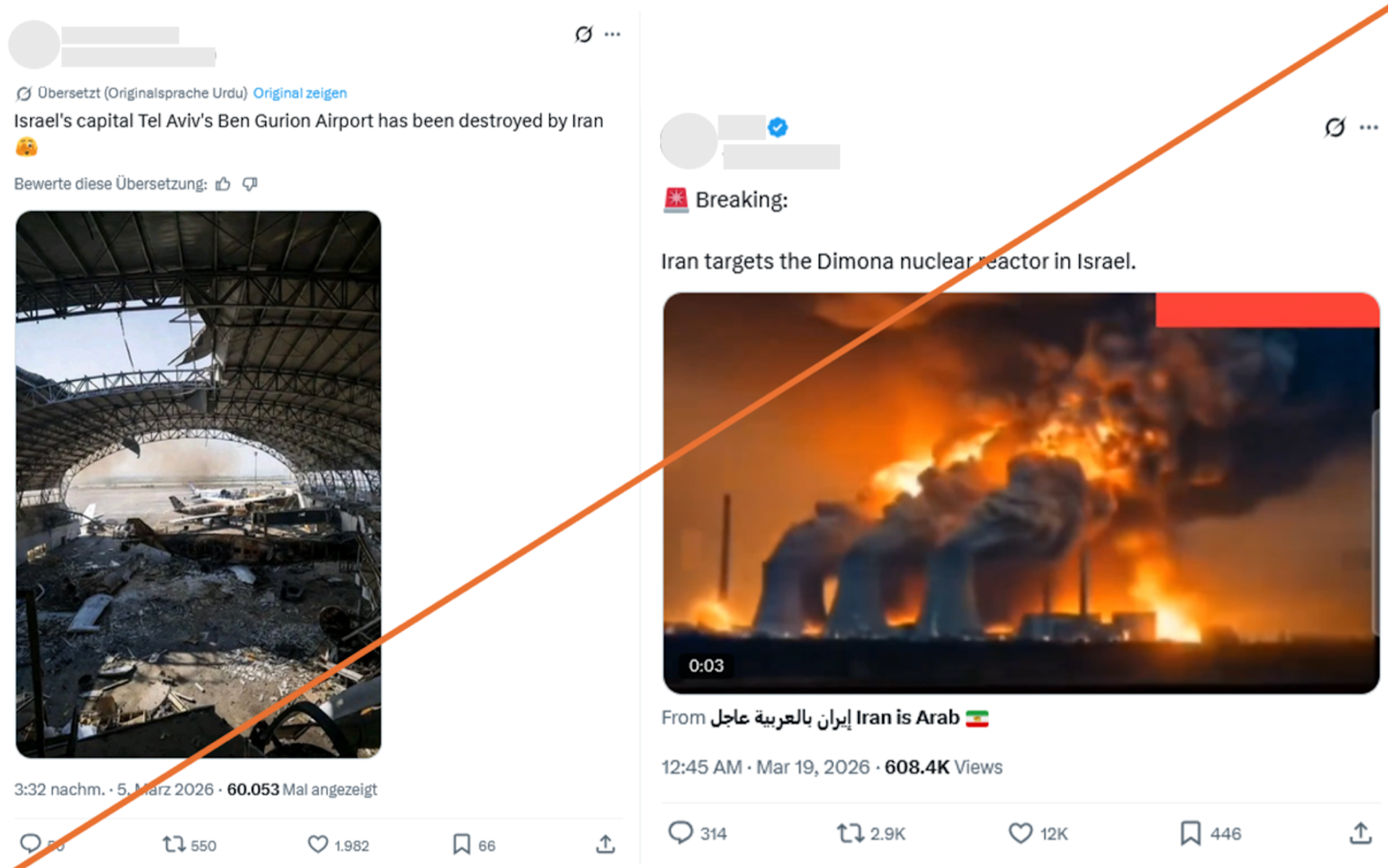

Das US-Unternehmen NewsGuard dokumentierte 50 Falschbehauptungen, die in den ersten 25 Tagen des Krieges in sozialen Medien verbreitet wurden. Die überwiegende Mehrheit davon – 92 Prozent, oder 46 von 50 Falschbehauptungen – unterstützte die Narrative des iranischen Regimes. Diese Posts enthielten typischerweise Behauptungen über angebliche iranische Schläge, insbesondere gegen Israel, die in Wirklichkeit nicht stattfanden, oder übertrieben die zugefügten Zerstörungen. Verbreitet wurden etwa falsche Bilder angeblicher Luftschläge gegen den Ben-Gurion-Flughafen in Tel Aviv oder eines angeblichen Brands und Zerstörungen in der Nuklearanlage in Dimona.

Außerdem behaupteten pro-iranische Accounts fälschlicherweise, dass der israelische Premierminister Benjamin Netanjahu, der Mossad-Chef David Bornea oder der Finanzminister Bezalel Smotrich getötet worden seien. Diese Falschbehauptungen, die darauf abzielten, die Stärke des iranischen Regimes zu übertreiben und die Moral der iranischen Truppen zu stärken, wurden laut NewsGuard nur zu einem geringen Teil von offiziellen Accounts iranischer Staatsmedien und überwiegend von pro-iranischen Accounts, die keine offenen Verbindungen mit dem Staat aufzeigten, verbreitet.

Acht Prozent der Falschbehauptungen in der NewsGuard-Datenbank enthielten pro-US oder pro-israelische Narrative, z.B. die Falschbehauptung, dass der iranische Staat die Verantwortung für die Zerstörung der Mädchenschule in der iranischen Stadt Minab übernommen haben soll. Laut den vorläufigen Ergebnissen einer US-Untersuchung soll das US-Militär für diesen Luftschlag verantwortlich gewesen sein, bei dem mutmaßlich veraltete Daten für die Zielerfassung verwendet wurden.

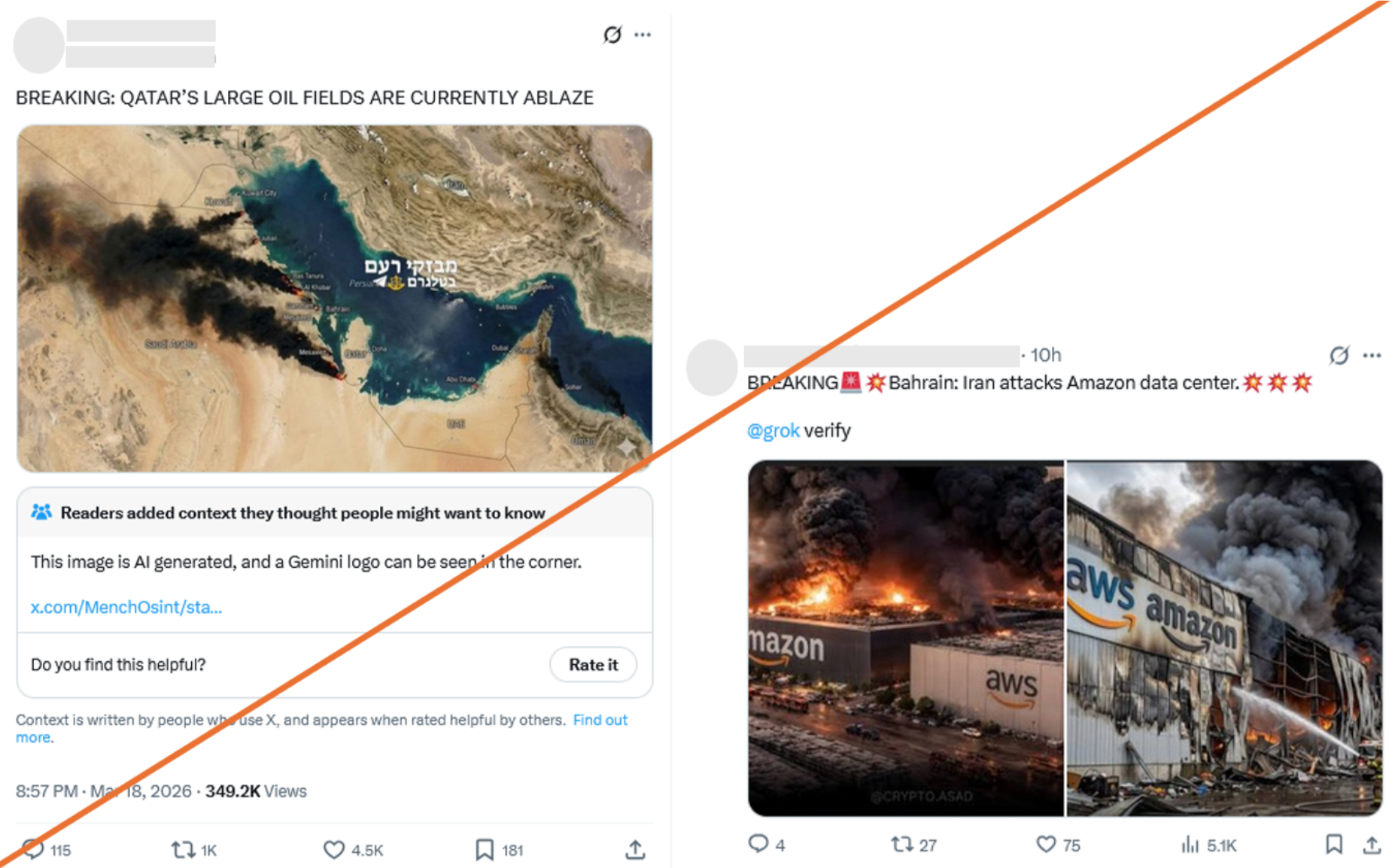

Während zu Beginn des Krieges vor allem alte, aus dem Kontext gerissene Bilder und Videos als Belege herangezogen wurden, wird die visuelle Desinformation inzwischen von KI-generierten oder KI-manipulierten Inhalten dominiert. KI-generierte Inhalte sind typischerweise an Wasserzeichen der KI-Tools, unrealistischen Proportionen, Schatten und Lichtverhältnissen zu erkennen – wobei die fotorealistische Qualität der KI-generierten Inhalte immer besser wird, sodass nur aufwändige forensische Recherchen die Unechtheit nachweisen können.

Zu den KI-generierten visuellen Inhalten, die im Kontext des Krieges im Nahen Osten verbreitet werden, gehören etwa gefälschte Satellitenbilder, die brennende Ölfelder oder einen angeblich zerstörten US-Radar in Katar nach iranischen Angriffen zeigen, oder ein KI-generiertes Video mit der angeblichen Zerstörung des US-Schiffs Abraham Lincoln.

Liar’s dividend: Wenn echte Bilder als KI angezweifelt werden

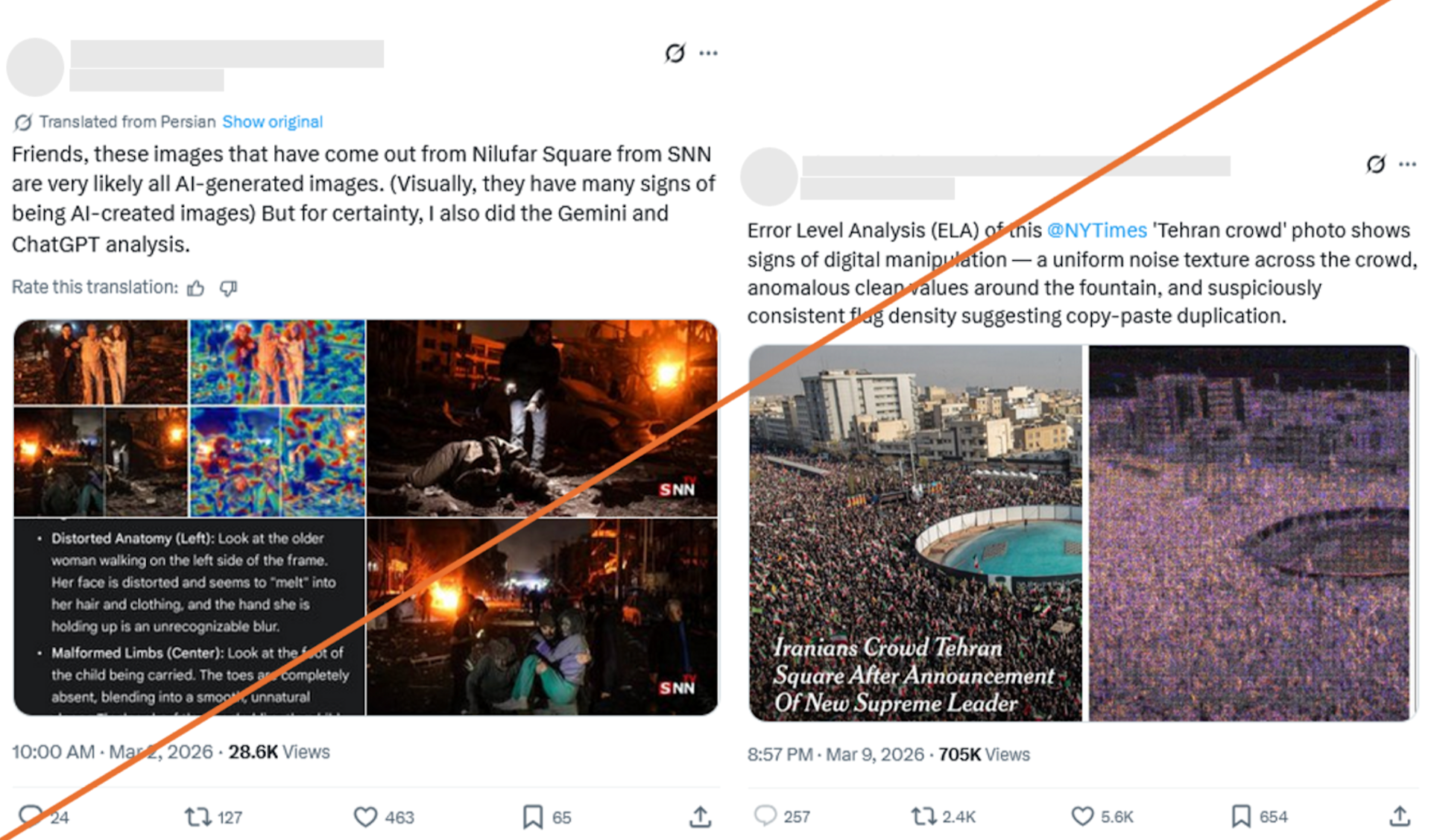

Die Fortschritte der generativen KI und die dadurch erschwerte Überprüfung der Echtheit der Bilder führten auch dazu, dass in sozialen Medien echte Bilder als KI-generiert abgelehnt und angezweifelt wurden. Dieses Phänomen ist als „Liar’s dividend“ bekannt: Die Unsicherheit darüber, welche Inhalte echt und welche synthetisch sind, erlaubt es insbesondere Politiker:innen und Personen des öffentlichen Lebens, echte Evidenz für Missstände als KI-manipuliert abzulehnen. Während des Krieges im Nahen Osten werden echte Bilder von Accounts angezweifelt, um eigene politische Positionen und Interpretationen des Konflikts zu verbreiten.

Ein echtes Video einer Ansprache von Benjamin Netanjahu wurde in sozialen Medien beispielsweise als KI-generiert angezweifelt. Die Social-Media-Accounts verbreiteten dabei die Falschbehauptung, dass Netanjahu angeblich vom Iran getötet oder schwer verletzt worden sei.

Auch echte Bilder aus dem Iran wurden mehrfach fälschlicherweise als KI-generiert oder -manipuliert bezeichnet. So behauptete auf X ein Account namens “The Empirical Research and Forecasting Institute”, dass ein Bild, das die Zeitung The New York Times veröffentlichte und das eine Menschenmenge in Teheran nach der Wahl von Mojtaba Khamenei zum neuen Obersten Führer des Irans zeigte, manipuliert sei. Als Beweis veröffentlichte der Account eine forensische Analyse, die jedoch irreführend ist: Für die Analyse wurde ein Screenshot eines Instagram-Posts verwendet, also ein Bild mit einer niedrigen Auflösung. Die Analyse eines solchen Bildes liefert in diesem Fall keine Manipulationsbelege. In einem anderen Fall wurden Bilder, die Verletzte und Zerstörungen nach einem Luftschlag auf dem Niloofar-Platz in Teheran zeigen, als KI-generiert angezweifelt.

Nutzer:innen der sozialen Medien wenden sich mit Faktencheck-Fragen zunehmend auch an KI-Chatbots, die für diese Aufgabe nicht geeignet sind und regelmäßig falsche Antworten liefern. So behauptete das KI-Tool Grok von X fälschlicherweise, dass die Bilder der zerstörten Mädchenschule in Minab, die das ZDF zeigte, angeblich nicht aus dem Iran stammen – in Wirklichkeit waren die Bilder echt.

Verharmlosung der Gewalt als Memes und Unterhaltung

Die generative KI wird auch eingesetzt, um Inhalte zu produzieren, die nicht vorgeben, realistisch zu sein, sondern auf den überraschenden oder skurrilen Effekt setzen. Auf X ging etwa ein Post der iranischen Botschaft in Südafrika mit einem KI-generierten Video viral. Das Video zeigt einen Raketenstart und einen lachenden iranischen Soldaten auf einem Skateboard mit der Überschrift: „Der lustige Beitrag von heute: Trink Granatapfelsaft, damit du Tel Aviv besser triffst“. Mit solchen meme-artigen Inhalten soll die militärische Gewalt normalisiert oder glorifiziert werden. Ebenfalls KI-generiert sind zahlreiche Videos, die attraktive Frauen in der iranischen Militäruniform zeigen – in Wirklichkeit dürfen im Iran Frauen nicht in der Armee dienen.

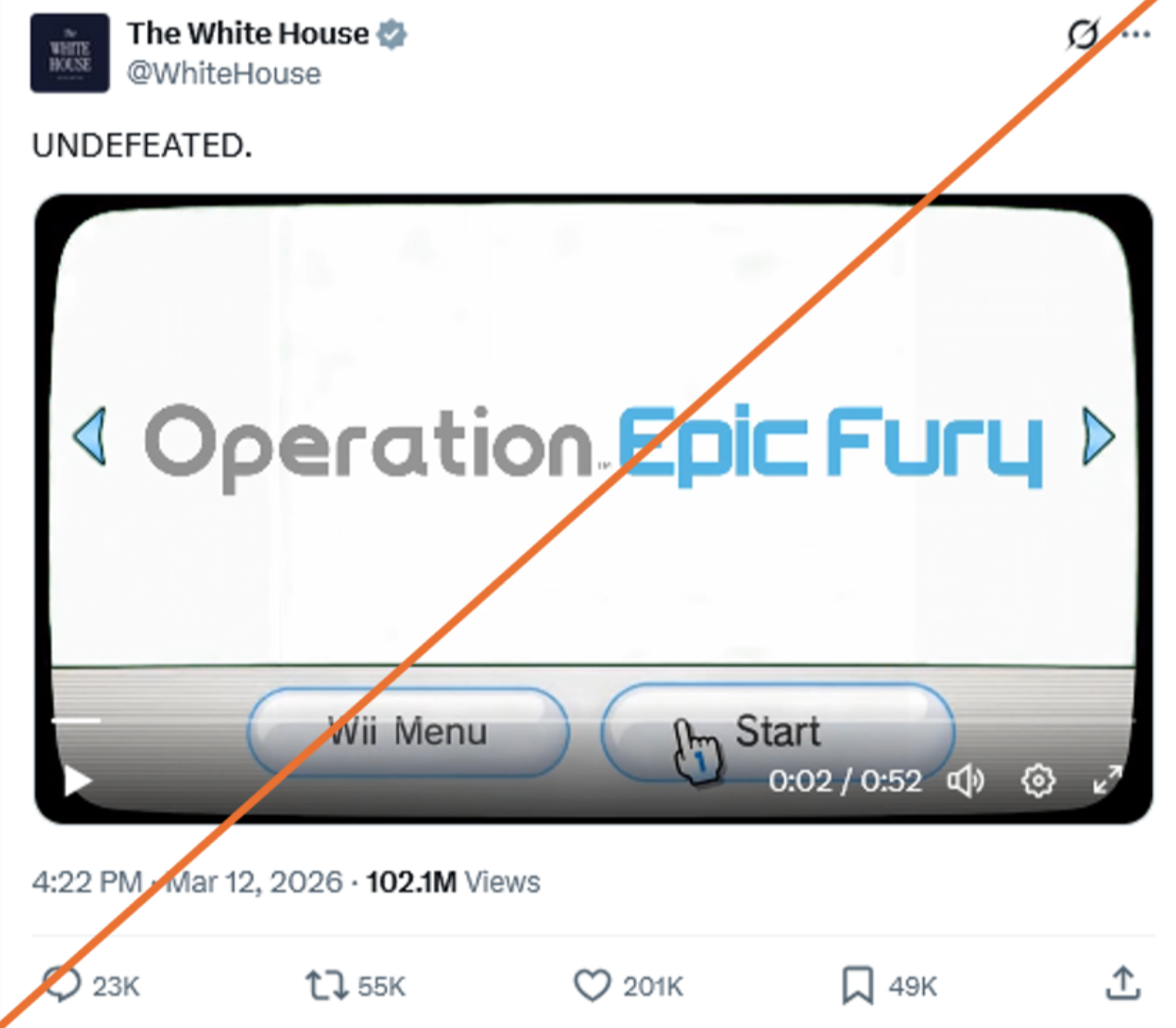

Einen ähnlichen Effekt können aber auch Inhalte ohne KI haben, wie mehrere Posts des Weißen Hauses über den Krieg zeigen: Echte Kriegsbilder wurden in einem davon mit Szenen aus Filmen und Videospielen und in einem anderen mit Bildern von Wii-Videospielen gemischt, was den Krieg als ein lustiges Spiel zeigt. In einem weiteren Video werden Kriegsbilder mit Pop-Musik unterlegt, was sie als unterhaltsam und spielerisch erscheinen lassen soll.

Social-Media-Plattformen nicht auf die Flut der Kriegspropaganda vorbereitet

Die Tatsache, dass zahlreiche Beiträge mit Falschinformationen, KI-generierten Inhalten und der Normalisierung von Gewalt viral gehen, zeigt, dass die Social-Media-Plattformen auf die massenhafte Verbreitung von Kriegspropaganda und Desinformation schlecht vorbereitet waren. X kündigte an, Accounts aus dem Monetarisierungsprogramm zu entfernen, wenn sie KI-generierte Inhalte über Kriege ohne entsprechende Kennzeichnungen posten. Allerdings dürfte dies keinen Einfluss auf politische Akteur:innen haben. Um diesem Problem angemessen zu begegnen, müssen die Plattformen ihre internen Ressourcen zur Identifizierung nicht-authentischer Aktivitäten und staatlicher Desinformation deutlich erhöhen. Außerdem sollten die internen Systeme zur Erkennung illegaler Inhalte verbessert werden. Die Online-Flut aus Desinformation und der Glorifizierung von Gewalt in Kriegen kann sehr reale Folgen haben – in Form von weiterer Gewalt und unaufgeklärten Verbrechen.